Por qué debes evitar usar a la I.A. como terapeuta: acá los riesgos

Cada vez más personas hablan de su salud mental y ponen sobre la mesa sus emociones, ansiedad o límites personales sin sentirse juzgadas. Esa apertura trajo beneficios, pero también generó ideas confusas sobre cómo se ve el bienestar emocional en la vida diaria.

Te puede interesar

El futuro del ecommerce: operaciones agénticas con inteligencia artificial

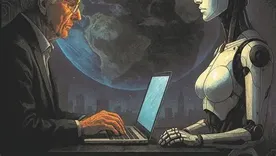

Frente a ese panorama, aparecen soluciones gratuitas o de bajo costo que intentan cubrir una necesidad urgente. Las aplicaciones de meditación, los videos motivacionales y los chats automatizados se presentan como respuestas inmediatas. La inteligencia artificial se suma a esa lista con promesas rápidas y respuestas sin espera.

El uso de plataformas como ChatGPT para hablar sobre emociones va en aumento. Muchos lo ven como un espacio seguro para expresar lo que no se animan a decir en voz alta. La respuesta llega sin juicio, sin miradas incómodas, sin la presión de sentirse evaluado. Parece ideal, pero hay un problema de fondo.

-

Te puede interesar

La relación con los clientes ya no se gestiona, se orquesta

Una conversación con una inteligencia artificial no equivale a un proceso terapéutico. La IA entrega palabras basadas en patrones, pero no construye un vínculo real. No tiene memoria emocional, no interpreta silencios, no detecta señales de alerta que solo un ser humano con formación clínica puede captar.

La terapia se basa en la relación entre paciente y profesional. Ese vínculo requiere confianza, tiempo y presencia activa. El terapeuta escucha más allá de las palabras y responde desde el análisis, no desde un algoritmo. Aunque una IA sea precisa al responder, no vive ni siente.

El peligro aparece cuando alguien confunde una conversación útil con un tratamiento. Hablar con una máquina puede ayudar a pensar, pero no sustituye el acompañamiento de alguien entrenado para contener, analizar y guiar. El riesgo es quedarse en la superficie, creyendo que hablar ya es sanar.

Además, una inteligencia artificial no tiene criterio clínico. No evalúa síntomas con profundidad ni sugiere intervenciones seguras en situaciones complejas. No tiene herramientas para manejar casos urgentes, ni para identificar señales de riesgo en tiempo real. Si la persona está en crisis, el error puede ser grave.

Tampoco hay responsabilidad legal cuando la IA se equivoca. Si un consejo humano genera daño, hay un sistema que interviene. Pero si una IA responde de forma dañina, no hay consecuencias para la plataforma ni para quienes la usan como recurso terapéutico. Eso deja a la persona sola frente a su malestar.