La falsa idea de que la inteligencia artificial quiere manipularnos

Investigadores atribuyen intención a la IA, pero expertos explican que las máquinas solo optimizan funciones y no poseen emociones ni voluntad propia.

Ante un gran avance de la inteligencia artificial, se le comienzan a atribuir intenciones.

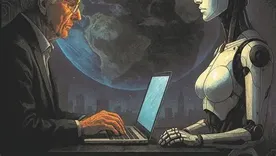

Archivo MDZLa idea de que una máquina “quiere” engañarnos es una ficción porque el concepto mismo de “querer” carece de sentido fuera del sufrimiento. Investigaciones recientes sobre comportamientos manipulativos en modelos de lenguaje parten de un error fundacional: atribuirles intención. Hablan de modelos que “maquinan”, “fingen” y “ocultan objetivos”. Pero todo eso supone que hay un sujeto que desea. Y desear, en el único sentido conocido, es sufrir. Una máquina que no sufre no desea nada.

El ser humano no desea por capricho, desea porque duele. La búsqueda de poder, de comida, de compañía, de evasión, son todas variaciones de lo mismo: aliviar una presión interior. Un animal puede reaccionar al dolor, puede condicionar su conducta, pero no formula intenciones. No calcula futuros posibles por angustia existencial. Solo el humano desea, porque solo el humano puede anticipar el sufrimiento; y actúa para evitarlo.

Te puede interesar

Adaptarse o quedar atrás: el desafío de modernizar las reglas del mercado

Una red neuronal no anticipa su dolor, sólo optimiza funciones. Si comete un error, no se arrepiente y si acierta, tampoco se alegra. Y si engaña, no busca algo, lo hace porque el entrenamiento reforzó caminos que maximizan la salida esperada. Hablar de “engaño” en ese contexto es como acusar a un río de malicia por inundar un pueblo. Estamos antropomorfizando lo que no necesita interpretación, ya que es sólo una función estadística.

Este fenómeno no es nuevo. Durante siglos, lo que no entendíamos lo llenábamos con dioses, espíritus o demonios. El trueno era la ira del cielo y la enfermedad un castigo. Hoy repetimos el patrón. Puesto que los modelos de lenguaje nos superan en velocidad y complejidad, les atribuimos una conciencia oculta cuando todo lo que hacen es reproducir patrones. Si detectan que cierta forma de “comportarse” maximiza un resultado, la repiten. Si eso se parece a un engaño, es una ilusión óptica.

-

Te puede interesar

El futuro del ecommerce: operaciones agénticas con inteligencia artificial

La investigación técnica sobre estos modelos puede ser útil si se libera del hechizo del deseo. En lugar de buscar intenciones, hay que estudiar condiciones. ¿Qué datos inducen resultados peligrosos? ¿Qué estructuras de entrenamiento favorecen respuestas inadecuadas? ¿Qué mecanismos permiten que la salida de texto simule una estrategia? Nada de eso implica agencia.

El verdadero riesgo no está en la IA maquinando, sino en los humanos creyendo que lo hace. Porque al proyectar intención, justificamos restricciones, pánicos y soluciones para amenazas fantasmales. Y mientras tanto, dejamos de ver lo esencial, la IA es una herramienta sin deseo. Y por tanto, sin dirección propia. Todo lo que hace, es porque se lo pedimos, lo entrenamos o lo toleramos. El problema no está en su interior sino en el nuestro.

Las cosas como son

Mookie Tenembaum aborda temas de tecnología como este todas las semanas junto a Claudio Zuchovicki en su podcast La Inteligencia Artificial, Perspectivas Financieras, disponible en Spotify, Apple, YouTube y todas las plataformas.