Los 'dueños' de la inteligencia artificial crean un foro para regularla

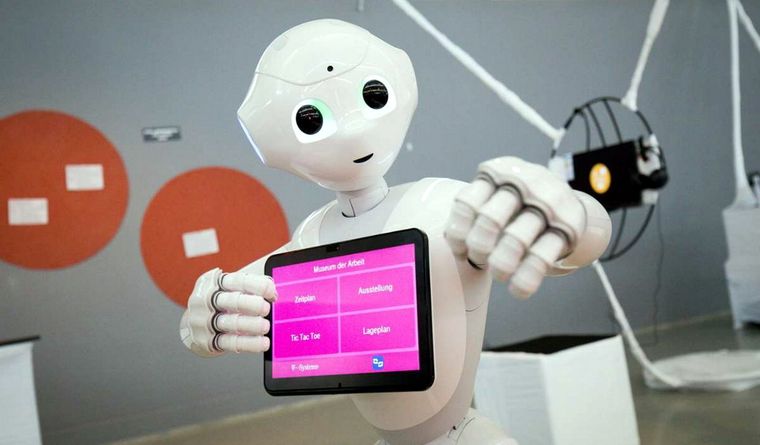

La inteligencia artificial puede ser perjudicial para el usuario y su salud mental. Foto: Dpa

DPARegular el desarrollo: ese es, aparentemente, el propósito de enormes empresas tecnológicas, como lo son Google, Microsoft, OpenAI y Anthropic.

Te puede interesar

Google lanza la primera beta de Android 17 QPR1 para los Google Pixel

Estas compañías comunicaron que crearán una "plataforma de vigilancia para ayudar a regular el avance de la inteligencia artificial (IA)".

Las empresas firman un manifiesto, revelado en el blog de Microsoft y también por Openai, llamado Frontier Model Forum. Dice en un fragmento: "un organismo de la industria centrado en garantizar el desarrollo seguro y responsable de modelos de IA fronterizos, o sea, aquellos modelos que superan las capacidades que poseen los modelos más avanzados".

Indican los gigantes que los propósitos más relevantes del foro de tecnología radican en "hacer avanzar la investigación sobre la seguridad de la IA promoviendo un estándar para minimizar los riesgos y centrarse en desarrollar las mejores prácticas para el despliegue de modelos vanguardistas y colaborar con legisladores, académicos, sociedad civil y empresas para compartir conocimientos sobre riesgos de confianza y seguridad".

Asimismo, aporta Rt, el foro hará foco en "abordar los grandes desafíos de la sociedad, incluida la mitigación y adaptación al cambio climático, la detección y prevención tempranas del cáncer y la lucha contra las amenazas cibernéticas".

"El Foro será un vehículo para debates y acciones entre organizaciones sobre seguridad y responsabilidad de la IA", juran.

La agencia continúa señalando que próximamente se armará "una junta asesora destinada a dirigir la estrategia y las propiedades del grupo. Para poder formar parte de la iniciativa, las organizaciones deben ajustarse a los criterios predefinidos".

Brad Smith, titular de Microsoft, concluye: "las empresas que crean tecnología de IA tienen la responsabilidad de garantizar que sea segura y permanezca bajo control humano. Esta iniciativa es un paso vital para unir al sector tecnológico en el avance de la IA de manera responsable y abordar los desafíos para que esta beneficie a toda la humanidad".

Video: qué es la IA

Blog.microsoft, Openai, Rt, ComputerHoy, Youtube.