¡Cuidado! Claude usará tus chats para entrenar su IA

Los usuarios de Claude deberán revisar los nuevos términos de uso de Anthropic, que permiten utilizar conversaciones para entrenar la IA y conservar datos.

La IA de Antropic se actualiza con mejoras en tokens.

ShutterstockEl anuncio de que Claude usará las conversaciones de los usuarios para entrenar sus modelos de inteligencia artificial generó debate entre quienes ya utilizan esta herramienta. Anthropic confirmó que, salvo que se desactive la opción en la configuración de la cuenta, la compañía podrá emplear tanto chats como sesiones de código, además de conservar la información hasta cinco años.

Qué cambia en la política de Anthropic

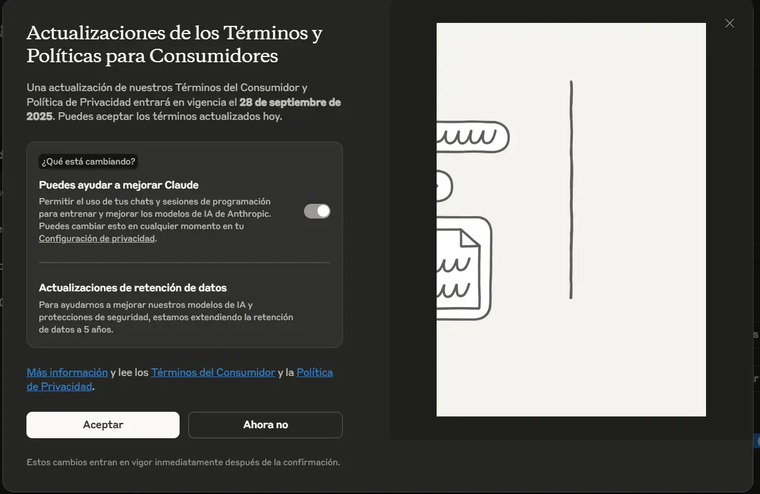

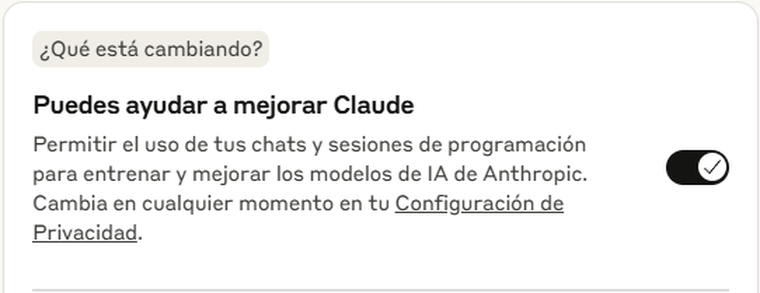

La empresa comunicó que desde el 28 de septiembre de 2025 los Términos del Consumidor incluirán cláusulas que autorizan el uso de entradas y salidas de los usuarios. Aunque la característica se activa por defecto, puede desmarcarse en la pantalla inicial o dentro del menú de privacidad.

En los términos se lee: “Podemos usar sus Entradas y Salidas para entrenar nuestros modelos y mejorar nuestros Servicios, a menos que opte por no participar”. Aun con la exclusión, la compañía se reserva la posibilidad de revisar contenidos marcados por motivos de seguridad o reportados por los propios usuarios.

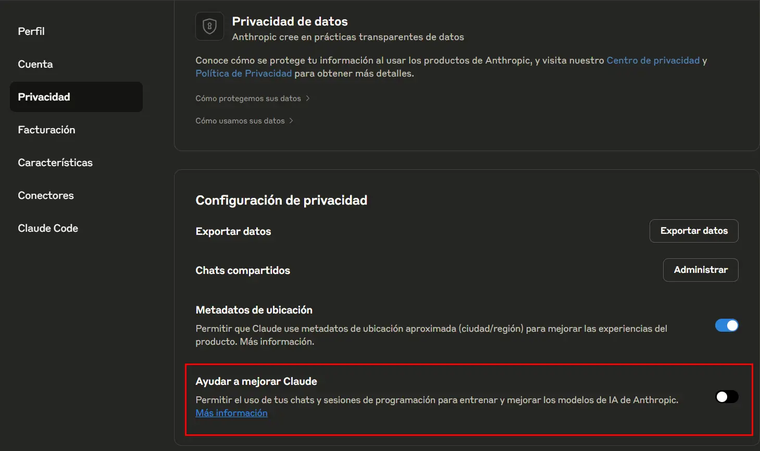

Cómo desactivar el uso de tus conversaciones

Para quienes no deseen que Anthropic utilice sus datos, el procedimiento es simple: entrar al perfil, seleccionar el apartado Privacidad y desactivar la opción “Ayudar a mejorar Claude”. Además, se recomienda deshabilitar el registro de metadatos de ubicación para evitar que la compañía conozca desde dónde se utiliza el servicio.

Los cambios también establecen que, con el fin de fortalecer las medidas de seguridad, los datos podrán conservarse durante cinco años. Esto incluye todas las interacciones previas con los sistemas de Anthropic, independientemente de si se usan para entrenamiento.

La decisión de Anthropic llega poco después de reconocer incidentes en los que hackers utilizaron Claude Code para intentar ciberataques y campañas de ransomware. Según un informe oficial, un actor malicioso empleó la IA para planear la extracción de datos, calcular costos de extorsión y redactar notas de rescate dirigidas a 17 compañías.

La empresa aseguró que bloqueó esas cuentas e implementó medidas adicionales para mitigar riesgos futuros. Sin embargo, el nuevo enfoque sobre el uso de datos abre un debate sobre privacidad, transparencia y la confianza en asistentes de inteligencia artificial.