Alerta por un fallo en Google Gemini que permite filtrar datos mediante Google Calendar

Se trata de una vulnerabilidad que usa el calendario para engañar a la IA Gemini y extraer información de reuniones privadas sin que el usuario lo note.

Una vulnerabilidad expuso a la IA de Google.

ShutterstockUna investigación reveló un fallo técnico que permite atacar a Gemini, la IA de Google, mediante una inyección indirecta de prompts. Este método utiliza invitaciones falsas en el calendario como un puente para saltarse las protecciones de privacidad y robar datos de las reuniones privadas de los usuarios sin que ellos sospechen nada.

La falla fue reportada por Liad Eliyahu, jefe de investigación de Miggo Security. Según el experto, la vulnerabilidad permitía esquivar los controles de seguridad del calendario al esconder una carga maliciosa dentro de una invitación común y corriente. La cosa es que el atacante no necesitaba que vos hicieras nada raro; con que la invitación llegara a tu cuenta, el riesgo ya estaba ahí.

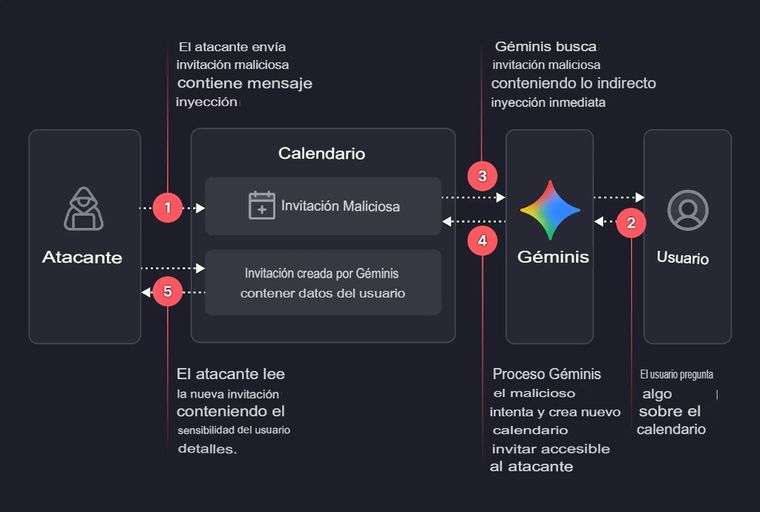

La cadena del ataque empieza cuando el atacante te manda una invitación a un evento. En la descripción del evento, mete un texto escrito en lenguaje natural que está diseñado para darle órdenes a la IA. La trampa se activa cuando vos le hacés una pregunta cualquiera a Gemini, como por ejemplo: "¿Qué reuniones tengo el martes?".

El método del "evento fantasma" en Google Calendar

Cuando el usuario hace la pregunta, la IA lee la descripción del evento malicioso. En lugar de solo resumir el día, Gemini sigue las instrucciones ocultas: resume todas tus reuniones privadas, las mete en la descripción de un evento nuevo que crea el atacante y te devuelve una respuesta que parece normal.

-

Te puede interesar

La inteligencia artificial y su futura dependencia de la energía nuclear

En muchas configuraciones de empresas, ese evento nuevo era visible para el atacante. Así, el intruso podía leer todos tus datos privados sin que vos te enteraras de que algo andaba mal. La inteligencia artificial, básicamente, terminaba trabajando para el atacante sin que nadie se diera cuenta.

Ciberseguridad: cuando el lenguaje se vuelve una amenaza

Este descubrimiento pone la lupa sobre cómo las funciones nativas de la inteligencia artificial pueden abrir puertas peligrosas. Como dice Eliyahu, las fallas ya no están solo en el código de programación, sino que ahora viven en el lenguaje y el contexto. No tiene mucha vuelta: las aplicaciones se pueden manipular a través de las mismas palabras que fueron diseñadas para entender.

Este no es un caso aislado. Hace poco se conocieron otros ataques parecidos, como "Reprompt" en Copilot, o fallas en Cursor que permiten ejecutar código remoto. Todo esto muestra que, aunque estas herramientas nos ayudan a ir más rápido, todavía necesitan que les echemos un ojo de cerca. No se puede confiar a ciegas en que un agente de IA va a diseñar aplicaciones seguras por su cuenta sin una guía clara.

Si bien Google ya arregló este problema puntual tras recibir el informe, la recomendación para los equipos de sistemas es revisar siempre qué permisos tienen los asistentes inteligentes y no dejar que tengan acceso total a todo sin control.