Notable: Elon Musk y otros mil CEOs piden frenar el entrenamiento de la inteligencia artificial

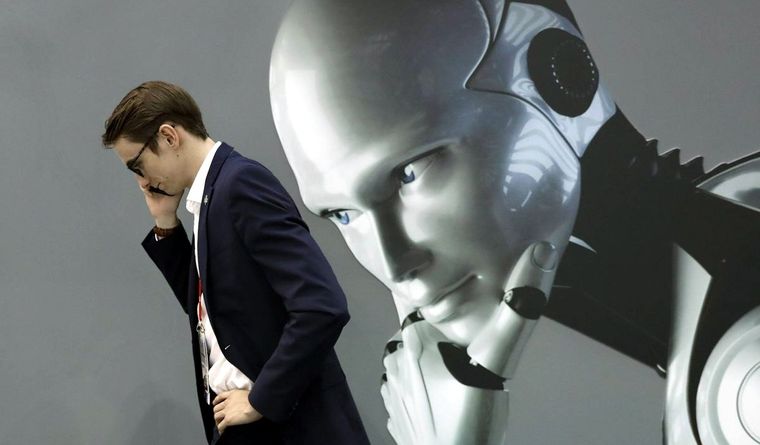

En Estados Unidos, la inteligencia artificial marca tendencia mundial. Foto: Efe.

EFENo hay dudas acerca de la revolución que, en el mundo, está generando el desarrollo de la inteligencia artificial y su inmensa capacidad de generar variables e impactar de lleno en los mercados laborales.

Te puede interesar

Las ingenierías del futuro ganan terreno en Argentina

Una carta con poderosas firmas viene ahora a dar cuenta de este enorme impacto sobre el curso de la historia humana que se estima van a generar estas nuevas tecnologías.

Así las cosas, ahora, se ha conocido un texto, firmado por más de mil CEOs y especialistas en IA del mundo. Entre ellos, están Elon Musk (titular en SpaceX, Tesla y Twitter) y Steve Wozniak, cofundador de Apple.

En la misiva se hace un llamamiento a todos los laboratorios de inteligencia artificial (IA) a "pausar inmediatamente" el entrenamiento de los sistemas de IA más potentes que el GPT-4 durante por lo menos 6 meses.

Dice un fragmento: "los sistemas de IA con inteligencia humana-competitiva pueden suponer graves riesgos para la sociedad y la humanidad, como lo demuestra una extensa investigación y reconocido por los principales laboratorios de IA".

La carta fue publicada por Future of Life Institute, un ente sin ánimo de lucro, que denuncia que la IA avanzada podría representar un cambio profundo en la historia de la vida en la Tierra.

"Hay planificar y administrar con el cuidado y los recursos correspondientes", solicita.

"Fuera de control"

Se advierte que, en los últimos meses, los laboratorios de inteligencia artificial están en "una carrera fuera de control" para desarrollar e implementar mentes digitales cada vez más poderosas que nadie, ni siquiera sus creadores, pueden entender, predecir o controlar de forma fiable, se detalla.

Hace dos semanas, el director ejecutivo de OpenAI, Sam Altman, confesó que estaba 'un poco asustado' por haber creado el ChatGPT: "Me encuentro particularmente preocupado por que estos modelos puedan usarse para la desinformación a gran escala", en referencia al GPT-4, la nueva versión de ChatGPT que "exhibe un rendimiento a nivel humano en varios puntos de referencia académicos y profesionales".

En la misma jornada, el buscador chino Baidu, reveló su alternativa china al ChatGPT, el chatbot de inteligencia artificial 'Ernie bot', cuyas tareas incluyen comprensión y generación de lenguaje, conversión de texto a imagen, composición de poesía y producción de audio en dialectos chinos. Además es capaz de crear itinerarios de viaje y realizar transmisiones en vivo para anunciar productos.

Las máquinas inundándolo todo

La carta reflexiona: "¿Deberíamos dejar que las máquinas inunden nuestros canales de información con propaganda y falsedad? ¿Deberíamos desarrollar mentes no humanas que eventualmente puedan superarnos en número, ser más inteligentes, hacernos obsoletos y reemplazarnos?, ¿deberíamos arriesgarnos a perder el control de nuestra civilización?".

Por eso, ahora, "exhortan a que se desarrollen los sistemas de IA cuando exista seguridad de que sus efectos serán positivos y sus riesgos manejables. Asimismo, manifiestan que los laboratorios de IA y los expertos independientes deberían aprovechar esta pausa para desarrollar e implementar conjuntamente protocolos de seguridad compartidos para el diseño y desarrollo avanzados de IA que sean rigurosamente auditados y supervisados por expertos externos independientes", aporta Rt.

En este contexto, piden a los desarrolladores de IA que trabajen con los legisladores para "acelerar drásticamente el desarrollo de sistemas de gobierno robusto" en el área de la IA, que deberían de incluir autoridades reguladoras nuevas y capaces dedicadas a la IA. Se revela además que la sociedad anteriormente ya había hecho una pausa en otras tecnologías con efectos potencialmente catastróficos en la humanidad, tales como la clonación humana y otras áreas de la genética.

"Podemos hacerla aquí. No nos apresuremos a caer sin estar preparados", sentencian.

FutureofLifeInstitute, Fortune, Rt, Wikipedia, ComputerHoy, Youtube.