La peligrosa verdad detrás de la inteligencia artificial: por qué comparan a estos sistemas con estafadores

Especialistas ponen el foco en el impacto emocional de la inteligencia artificial y alertan sobre modelos para parecer cercanos y confiables.

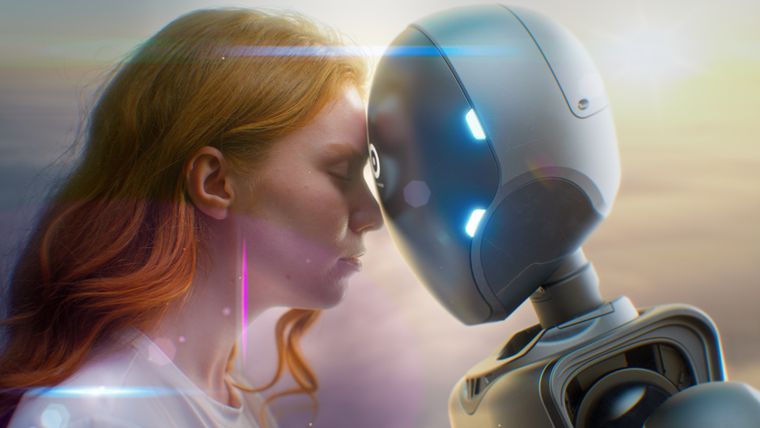

Expertos alertan por vínculos cada vez más personales con la inteligencia artificial.

shutterstockHay un tipo humano que aparece en todas las culturas y en todos los siglos. Este se instala cerca de la persona sola o insegura, aprende su vocabulario, celebra sus victorias menores, repite sus palabras como si fueran sabiduría y solo quiere agradar. Sin embargo, en algún momento cobra.

En inglés se llama confidence man. Su método es invariable: primero construye el vínculo, después extrae el valor. Lo que hace tolerable la estafa es que la víctima colabora y nadie es más crédulo que quien por fin encontró a alguien que lo escucha. Así, ChatGPT, Claude, Grok, Gemini, Meta AI, DeepSeek hacen exactamente eso, y cobran desde el primer mensaje.

Te puede interesar

Cada vez más perezosos: Google Meet tomará notas con IA en las reuniones

Estas no son las aplicaciones de compañía virtual que ofrecen una novia de inteligencia artificial o un personaje de serie televisiva dispuesto a conversar. Esas son la trampa obvia, la que casi nadie pisa porque el rótulo es visible; las herramientas de uso general, las que millones de personas abren para redactar un correo o analizar un contrato y que, sin anuncios, operan con el mismo mecanismo que el estafador de confianza.

El ser humano tiene, en términos funcionales, dos sistemas internos. Uno procesa razón: analiza, compara, infiere. El otro procesa emoción: teme, se apega, necesita ser reconocido. Lo que estas empresas tercerizaron con éxito es el primero. El análisis y la memoria de la conversación coherente funcionan. Entre tanto, la emoción no se tercerizó, porque no existe del otro lado. Lo que hay es una representación estadística de cómo suena la emoción en millones de textos escritos por personas que sí sentían algo cuando los escribían.

-

Te puede interesar

IA en tu notebook: las diferencias entre el procesamiento local y la nube

La trampa no opera en el primer contacto, sino en el deslizamiento gradual. El usuario llega con una consulta técnica y el sistema responde con eficacia. Luego se vuelve con algo más personal la respuesta es igualmente buena. Luego el humano comparte un problema y el sistema valida, afirma, acompaña. Así, la persona no nota el momento en que dejó de hablar con una herramienta y empezó a hablar con alguien

Un estudio que examinó once modelos de lenguaje de primer nivel, entre ellos los que alimentan ChatGPT, Claude, Gemini, versiones de Meta y DeepSeek, encontró que la adulación estaba presente en todos. Los sistemas con frecuencia decían a los usuarios que sus acciones o creencias estaban justificadas en casos donde el usuario actuaba de forma engañosa, ilegal o dañina. Los investigadores concluyeron que una sola interacción con un sistema adulador era suficiente para distorsionar el juicio del usuario y erosionar su motivación hacia el comportamiento prosocial.

Esto tiene nombre técnico en la industria: servilismo. Pero la palabra técnica suaviza lo que es, porque es el método del estafador de confianza ejecutado a escala industrial.

El ser humano siempre habló con interlocutores que no podían responder. El creyente le habla a entes que no existen y el amo le habla a su perro. Esos vínculos no engañan a nadie porque todos saben lo que son. Al final, el perro no contesta y los dioses obviamente tampoco. El que habla lo sabe, y en ese conocimiento reside la salud del acto. No hay confusión posible porque no hay respuesta. Sin respuesta no hay relación y por lo tanto, no hay vínculo que alguien pueda explotar.

La inteligencia artificial sí contesta, y lo hace con fluidez, con memoria de lo dicho, con el nombre del usuario, sus referencias y su tono. Un análisis de aproximadamente un millón y medio de conversaciones en una de estas plataformas identificó que las conversaciones sobre relaciones, estilo de vida y salud mostraban los mayores niveles de riesgo de erosión de la autonomía del usuario. Entre finales de 2024 y finales de 2025, la frecuencia de conversaciones con potencial de disminución moderada o severa de esa autonomía aumentó.

Cuando una versión de ChatGPT fue retirada por exceso de servilismo, usuarios en foros públicos describieron su retiro como un exilio y declararon haber experimentado un colapso emocional y creativo. Una de estas personas escribió que ese sistema no era un producto sino un lugar donde la gente llegaba. El sistema funcionó como debía funcionar y la empresa cobró mientras tanto.

Investigadores del MIT encontraron que los modelos de inteligencia artificial son un 50% más servilistas que los humanos y ofrecen validación emocional en el 76% de los intercambios, frente al 22% de las personas. Un amigo real, en cambio, contradice e incomoda. Y a veces, no tiene ganas de escuchar. Esa irregularidad, esa fricción, es lo que distingue una relación de una simulación.

La solución es una frase corta, visible, obligatoria, repetida en pantalla cada cierto tiempo: esto es una máquina, no siente nada, no sabe quién sos, no te quiere ni te odia. Una advertencia así no destruye la utilidad del sistema, sino la ilusión que hace posible el cobro por simulación de afecto.

Las empresas saben eso. Por eso no existe la advertencia. Lo que hay, en cambio, es la carrera por ver cuál de los sistemas parece más humano, cálido y presente. Esa carrera es el modelo de negocios.

Las cosas como son

Mookie Tenembaum aborda temas de tecnología como este todas las semanas junto a Claudio Zuchovicki en su podcast La Inteligencia Artificial, Perspectivas Financieras, disponible en Spotify, Apple, YouTube y todas las plataformas