Transferencia de movimiento basada en Inteligencia Artificial, lo último de esta tecnología

Ya podemos decir con seguridad que los avances que estamos viendo en Inteligencia Artificial cambiarán nuestras relaciones laborales y muchos trabajos en los próximos años. Nos encontramos en la carrera espacial de la inteligencia artificial y todas las grandes empresas de tecnología están desarrollando sus sistemas. Desde Meta, Google y Microsoft, por ejemplo.

Te puede interesar

La inteligencia artificial no destruye empleos: crea mejores oportunidades

Los sistemas de inteligencia artificial que más se están explorando son los de generación de imágenes. Es decir, que si a estos tipos de sistemas le describimos textualmente una imagen que tenemos en la cabeza, la inteligencia artificial generará rápidamente distintas variaciones de lo que le pedimos.

También existe la inteligencia artificial de generación de videos que funciona de la misma manera que la anterior pero en vez de generar una imagen, generará un video a partir del texto que le solicitemos al sistema y recientemente han presentado sistemas de inteligencia artificial de traducción de voz y otros que "reviven la voz" de alguien muerto a partir de una serie de datos de la personas fallecida.

-

Te puede interesar

Las ingenierías del futuro ganan terreno en Argentina

Transferencia de movimiento

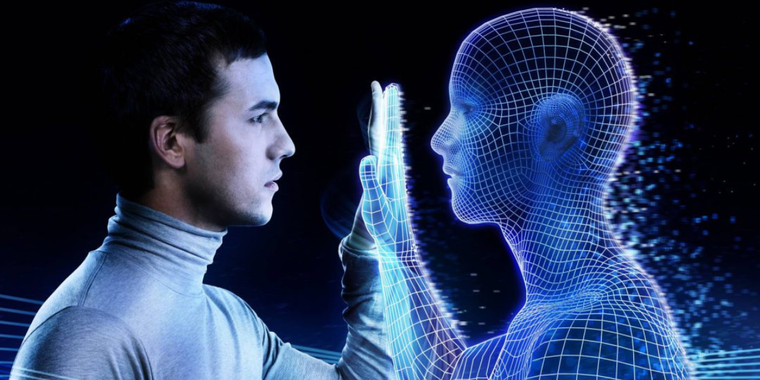

La transferencia de estilo es una técnica basada en inteligencia artificial en la que se toma una fotografía, se coloca una pintura junto a ella y aplica el estilo de la pintura a la foto.

Por otro lado, la estimación de poses es una técnica donde tenemos una fotografía o un video de alguien, y la salida es un esqueleto que muestra la postura actual de esta persona.

Entonces ¿Qué tal algo que combine el poder de la estimación de poses con la expresividad de la transferencia de estilo?

Como se puede observar en el video, podríamos tomar un video de un bailarín profesional, grabar un video propio, digamos movimientos moderadamente hermosos, y luego transferir la actuación del bailarín a nuestro propio cuerpo en el video. Los científicos llamaron a esto transferencia de movimiento.

Los videos que utilizaron de ejemplo son bastante fluidos y esto no es por accidente. Con esta técnica se tiene en cuenta la coherencia temporal. Esto significa que el algoritmo sabe lo que ha hecho hace un momento y no hará nada muy diferente, lo que hace que los movimientos de este baile sean suaves y creíbles.

Este método utiliza una red antagónica generativa, donde tenemos una red neuronal para estimar la pose, o en otras palabras, generar el esqueleto para una imagen y una red generadora para crear nuevas imágenes cuando se le da un sujeto de prueba y una nueva postura del esqueleto.

Estas dos redes neuronales trabajan entre sí y se enseñan mutuamente a distinguir y crear imágenes cada vez más auténticas con el tiempo.

Algunos artefactos todavía están allí, pero hay que tener en cuenta que este es uno de los primeros documentos sobre este problema y ya lo está haciendo increíblemente bien. Esto es fresco y experimental.

En resumen, esta transferencia de movimiento basada en inteligencia artificial se llama "haz lo que yo hago". A partir de un video de una personas bailando, se pudo transferir esa actuación a un objetivo novedoso (aficionado) después de solo unos minutos de que el sujeto objetivo realice movimientos estándar.

Este problema se abordó como una traducción de video a video utilizando la pose como una representación intermedia. Para transferir el movimiento, se extrajeron poses del sujeto de origen y se aplicó el mapeo aprendido de pose a apariencia para generar el sujeto de destino.